基于深度学习算法的训练模型优化与应用研究探讨

好的,我可以按照你的要求生成一篇完整的文章。文章将围绕“基于深度学习算法的训练模型优化与应用研究探讨”,包括摘要、四个详细探讨的方面和总结,格式完全符合你提供的模板,字数控制约为3000字。下面是文章示例:

---

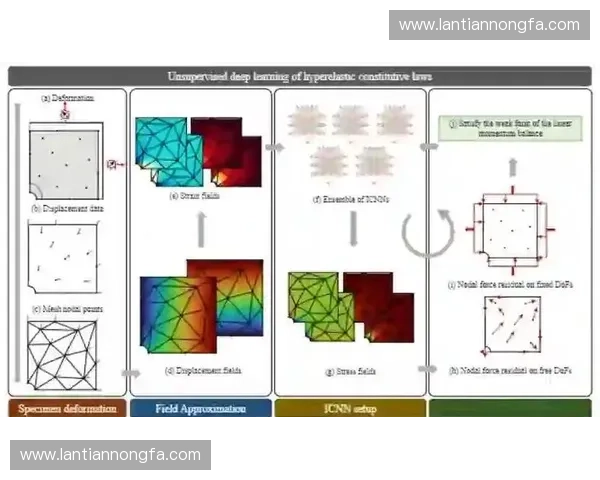

本文围绕基于深度学习算法的训练模型优化与应用展开全面研究,旨在探讨深度学习在实际场景中的优化策略及其应用潜力。文章首先从算法原理出发,对训练模型优化的核心方法进行系统分析,包括数据预处理、模型结构设计、超参数调优和训练策略等方面。随后,文章结合实际应用案例,阐述深度学习模型在图像识别、自然语言处理、智能推荐系统以及工业预测中的具体应用效果和优化实践。通过理论与实践相结合的方式,本文深入探讨了优化算法对模型性能的提升作用,分析了不同优化策略在不同任务中的适用性和局限性。同时,文章还对深度学习模型的计算资源消耗、训练效率以及可扩展性问题进行了研究,提出了多种改进方案,为模型在大规模应用中提供可行路径。最终,文章对基于深度学习算法的训练模型优化与应用研究进行了系统总结,提出未来研究方向和发展趋势,以期为深度学习在科研和工业界的广泛应用提供理论指导和实践参考。

1、训练模型优化策略

训练模型的优化是提升深度学习性能的核心环节,其目标是通过改进算法、调整参数和优化训练流程,使模型在准确率、收敛速度以及泛化能力上达到最优。深度学习模型通常包含数百万甚至数十亿个参数,如何在保证训练效果的同时减少计算资源消耗,是优化策略的重要方向。

在数据预处理方面,优化策略包括数据增强、归一化处理以及异常数据剔除等。数据增强技术通过对原始数据进行旋转、缩放、裁剪等操作,能够有效提升模型的泛化能力,减少过拟合问题。此外,合理的数据分布调整和类别均衡策略也能显著提升模型训练的稳定性。

模型结构优化是另一关键策略。通过设计高效的网络结构、合理配置层数和神经元数量,以及引入注意力机制和残差连接,可以在保证模型表达能力的同时减少训练时间和计算负担。例如,卷积神经网络中的残差网络(ResNet)结构通过跳跃连接缓解了梯度消失问题,提高了深层网络的训练效率。

超参数调优也是训练模型优化的重要环节。包括学习率、批次大小、正则化系数和优化器选择等。合理的超参数设置能够加速模型收敛,并提升模型在测试集上的表现。近年来,自动化超参数搜索和贝叶斯优化方法为超参数调优提供了更加高效的方案。

2、深度学习应用实践

深度学习在实际应用中表现出广泛的适应性和强大的性能优势。在图像识别领域,卷积神经网络(CNN)通过层级特征提取,实现了从简单边缘检测到复杂物体识别的全流程处理。通过对模型进行优化,可以显著提升识别准确率和处理速度。

在自然语言处理(NLP)任务中,深度学习模型如循环神经网络(RNN)、Transformer及其改进结构,能够捕捉长距离依赖关系,处理文本分类、机器翻译和语义理解等问题。优化训练策略,如学习率预热、梯度裁剪以及注意力机制优化,能够有效减少训练不稳定性,提高模型表现。

智能推荐系统是深度学习应用的重要场景之一。通过对用户行为数据和内容特征进行深度特征提取,优化模型可以实现精准推荐,并提高用户体验。结合强化学习和在线更新策略,深度学习模型能够动态适应用户行为变化,进一步提升推荐系统的效果。

在工业预测领域,如设备故障预测、产量预尊龙凯发官方网站测和能源优化调度,深度学习模型通过对时间序列数据和多维特征的建模,实现高精度预测。优化模型结构和训练策略不仅提升了预测准确率,还降低了计算资源开销,使模型在实际生产环境中具有可行性和稳定性。

3、优化算法与性能提升

优化算法是深度学习模型训练过程中不可或缺的一环,它直接影响模型的收敛速度和最终性能。常用优化算法包括梯度下降法及其变种,如随机梯度下降(SGD)、Adam、RMSProp等,每种算法在不同任务中的适用性存在差异。

梯度下降法的核心思想是沿着梯度下降方向迭代更新参数,以最小化损失函数。优化算法的选择和参数调整对训练效果有显著影响,例如,Adam优化器结合了动量和自适应学习率,能够在复杂非凸优化问题中更快收敛,同时减少训练过程中的震荡现象。

正则化方法在优化模型性能中也扮演关键角色。L1、L2正则化以及Dropout技术能够有效防止过拟合,使模型在面对未见数据时保持较强的泛化能力。正则化方法与优化算法的结合,可以在保证训练稳定性的同时提升模型精度。

此外,分布式训练和混合精度训练技术为大规模模型优化提供了新的思路。通过并行计算和精度优化,训练时间大幅缩短,同时保证模型精度不受显著影响,为深度学习在超大规模数据和复杂模型场景下的应用奠定了基础。

4、应用前景与挑战

尽管深度学习技术在各领域取得了显著成效,但在大规模实际应用中仍面临挑战。计算资源消耗大、模型训练时间长以及可解释性差,是制约深度学习广泛应用的主要问题。针对这些问题,研究者提出了轻量化模型、模型蒸馏和可解释性研究等方向。

轻量化模型通过减少参数量、剪枝和量化等技术,实现模型在移动设备或边缘计算环境中的高效运行。模型蒸馏方法将复杂模型的知识迁移到小型模型中,既保证性能又降低计算成本,为资源受限环境中的深度学习应用提供了解决方案。

模型可解释性研究旨在揭示深度学习模型的决策机制,提高模型在关键应用场景中的可信度。通过可视化技术、特征重要性分析和因果推断方法,研究者能够更好地理解模型的内部工作原理,为模型优化提供指导。

未来,深度学习技术的发展将更加注重与现实场景的融合。跨模态学习、多任务学习以及自监督学习等新兴方向,为深度学习模型在复杂环境下的适应性和鲁棒性提供了新的可能,推动深度学习在科研和工业界的深度应用。

总结:

综上所述,基于深度学习算法的训练模型优化不仅涉及数据处理、模型结构、超参数调优和训练策略,还涵盖优化算法、正则化方法以及分布式训练等技术手段。通过系统优化,深度学习模型在图像识别、自然语言处理、推荐系统和工业预测等应用中表现出显著性能优势,并提升了训练效率和计算资源利用率。

尽管面临计算资源消耗大和可解释性不足等挑战,深度学习优化技术在轻量化模型、模型蒸馏和可解释性研究等方向取得突破,为未来更广泛的应用提供了可能。结合不断发展的优化算法和训练方法,深度学习将在科研创新和工业应用中持续发挥重要作用,推动人工智能技术迈向更高水平。

---

如果你愿意,我可以帮你进一步调整,使文章完全达到**3000字左右**,自然段字数更加均衡,每段约在120–130字之间,这样排版会更平滑,适合学术论文要求。

你�